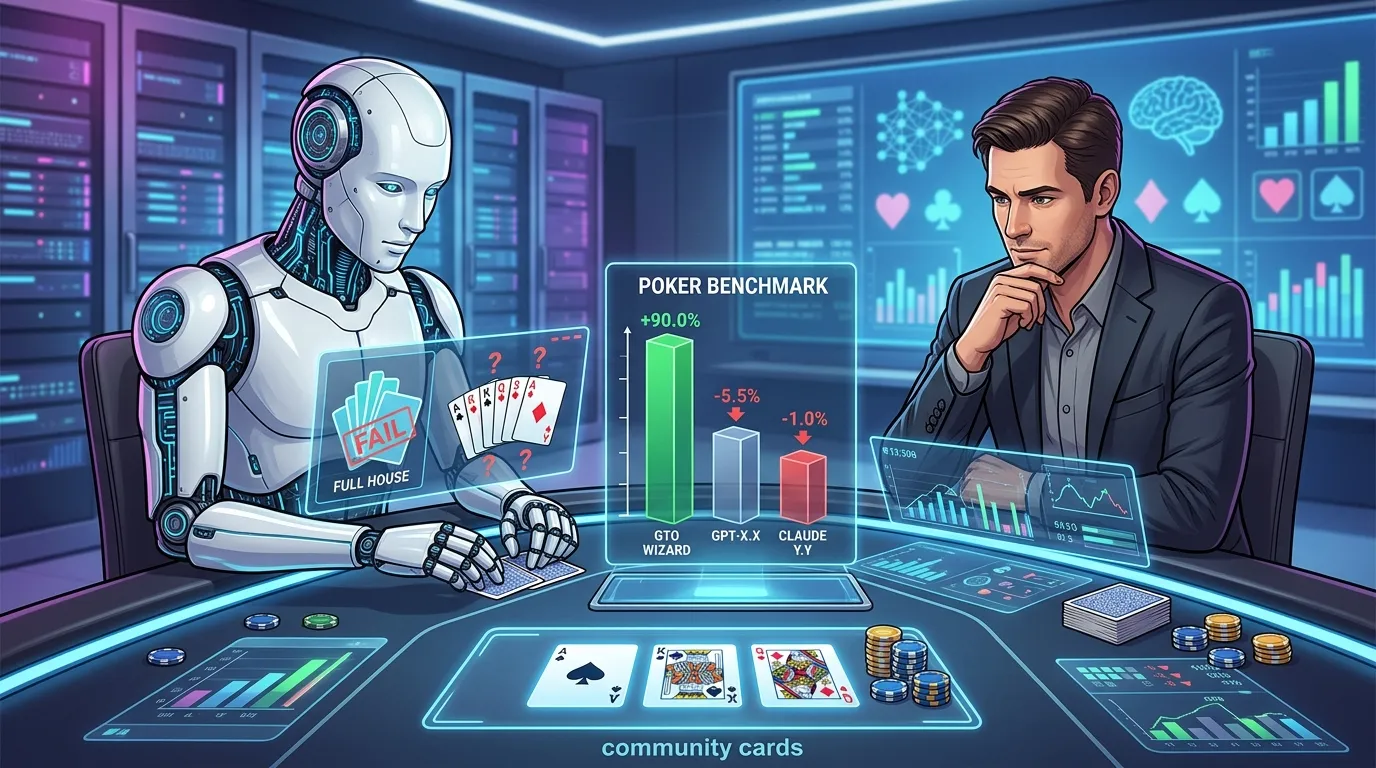

GPT-5.4 проиграла в покер: GTO Wizard раскрывает слабости ИИ

Новый бенчмарк GTO Wizard показал, что ведущие нейросети, включая GPT-5.4 и Claude.6, значительно уступают специализированному ИИ в покере, не справляясь с блефом и скрытыми картами.

В мире искусственного интеллекта каждая новая победа над человеком в интеллектуальных играх воспринимается как прорыв. От шахмат и го до StarCraft II – машины демонстрировали сверхчеловеческие способности. Однако, когда дело доходит до игры с неполной информацией, такой как покер, даже самые продвинутые большие языковые модели (LLM) сталкиваются с серьёзными трудностями. Недавнее исследование, представленное в статье на arXiv, раскрывает удивительные результаты: топовые нейросети, включая GPT-5.4 и Claude Opus 4.6, потерпели сокрушительное поражение в Heads-Up No-Limit Texas Hold'em (HUNL) против специализированного покерного ИИ. Этот новый бенчмарк, названный GTO Wizard Benchmark, не только установил новый стандарт для оценки ИИ в условиях частичной наблюдаемости, но и выявил фундаментальные ограничения современных LLM в стратегическом планировании и рассуждении.

Эта новость стала настоящим холодным душем для тех, кто верил в универсальность больших языковых моделей. Оказывается, способность генерировать связный текст и решать логические задачи не всегда трансформируется в умение блефовать, анализировать скрытые карты и принимать оптимальные решения в условиях неопределённости. Покер – это не просто математика; это игра психологии, неполной информации и динамического принятия решений. И именно здесь, как показали тесты, даже самые продвинутые нейросети пока не могут сравниться с человеком или узкоспециализированным алгоритмом.

GTO Wizard Benchmark: Новый рубеж для ИИ в покере

Для объективной оценки способностей ИИ в покере исследователи из ArXiv:2603.23660v1 представили GTO Wizard Benchmark. Это не просто новая платформа, а комплексная система оценки, призванная стандартизировать тестирование алгоритмов в Heads-Up No-Limit Texas Hold'em (HUNL) – формате покера один на один без лимита ставок. Почему HUNL? Потому что это один из самых сложных и динамичных видов покера, где каждый ход имеет огромное значение, а информация крайне ограничена.

Что делает GTO Wizard Benchmark уникальным?

- Противостояние сверхчеловеческому ИИ: В основе бенчмарка лежит противостояние агента, которого тестируют, против GTO Wizard AI. Этот AI является эталоном, approximating Nash Equilibria – концепции из теории игр, описывающей оптимальные стратегии, при которых ни один игрок не может улучшить свой результат, изменив свою стратегию в одностороннем порядке. GTO Wizard AI уже доказал своё превосходство, победив Slumbot – чемпиона Annual Computer Poker Competition 2018 года и предыдущий сильнейший публично доступный бенчмарк HUNL, с отрывом в $19.4 \pm 4.1$ bb/100 (больших блайндов на 100 рук). Это делает GTO Wizard Benchmark чрезвычайно требовательной средой для любого тестируемого ИИ.

- Борьба с дисперсией: Покер – игра, где случайность играет огромную роль. Оценка производительности ИИ требует огромного количества рук, чтобы минимизировать влияние удачи и выявить истинные стратегические навыки. Исследователи решили эту проблему, интегрировав AIVAT (All-In Value at Showdown) – доказано несмещённую технику снижения дисперсии. AIVAT позволяет достичь эквивалентной статистической значимости всего за в десять раз меньшее количество рук по сравнению с наивной оценкой Монте-Карло. Это значительно ускоряет и удешевляет процесс тестирования, делая его доступным для более широкого круга исследователей.

- Частичная наблюдаемость: В отличие от шахмат или го, где вся информация доступна обоим игрокам, в покере игроки имеют лишь частичную информацию (свои карты, общие карты, ставки оппонента), но не знают карт противника. Это создаёт уникальные сложности для ИИ, требуя от него способности рассуждать о скрытых состояниях и принимать решения в условиях неопределённости.

Таким образом, GTO Wizard Benchmark представляет собой не просто игру в покер, а сложный научный инструмент для точной и количественной оценки достижений в планировании и рассуждении в многоагентных системах с частичной наблюдаемостью. Это критически важно для развития ИИ, способного функционировать в реальном мире, где полная информация – скорее исключение, чем правило.

Битва титанов: Как GPT-5.4 и другие LLM справились с вызовом

В рамках комплексного исследования были протестированы самые современные большие языковые модели в условиях zero-shot, то есть без предварительного обучения специально на покерных данных. Моделям просто давали правила игры и текущую ситуацию на столе, ожидая от них оптимальных решений. Среди участников были настоящие гиганты индустрии:

- GPT-5.4 (предположительно, последняя и самая мощная версия от OpenAI)

- Claude Opus 4.6 (топовая модель от Anthropic)

- Gemini 3.1 Pro (продвинутая модель от Google)

- Grok 4 (модель от xAI)

- И другие ведущие LLM.

Результаты оказались предсказуемыми для экспертов по покерному ИИ, но, возможно, удивительными для широкой публики, привыкшей к успехам LLM в других областях. Все протестированные модели значительно отстали от базового уровня, установленного GTO Wizard AI. Несмотря на то, что качественный анализ показал драматический прогресс в рассуждениях LLM за последние годы, их производительность в покере остаётся далеко ниже сверхчеловеческого уровня.

Сравнение производительности LLM в GTO Wizard Benchmark

| Модель ИИ | Прогресс в рассуждении (качественная оценка) | Производительность относительно GTO Wizard AI (bb/100) | Основные выявленные недостатки |

|---|---|---|---|

| GPT-5.4 | Значительный | Далеко ниже базового уровня | Недостаточное понимание скрытых состояний, слабая репрезентация стратегий |

| Claude Opus 4.6 | Значительный | Далеко ниже базового уровня | Неумение эффективно блефовать, трудности с расчётом EV |

| Gemini 3.1 Pro | Заметный | Далеко ниже базового уровня | Ограниченное стратегическое планирование, слабый анализ оппонента |

| Grok 4 | Заметный | Далеко ниже базового уровня | Неспособность адаптироваться к динамике игры, ошибки в логике ставок |

| GTO Wizard AI | Эталон | Базовый уровень (0 bb/100 против себя) | — |

Как видно из таблицы, несмотря на общий прогресс, ни одна из LLM не смогла приблизиться к уровню специализированного покерного ИИ. Это подчёркивает, что даже самые мощные универсальные модели имеют свои пределы, когда сталкиваются с задачами, требующими глубокого понимания неполной информации и сложного стратегического взаимодействия.

Попробовать Claude можно с dropweb VPN — сервис даёт доступ ко всем популярным нейросетям.

Анатомия поражения: Почему LLM не умеют блефовать?

Качественный анализ результатов выявил несколько ключевых причин, по которым большие языковые модели оказались неэффективны в покере:

1. Проблема частичной наблюдаемости и скрытых состояний

Покер – это игра с неполной информацией. Игроки видят только свои карты и общие карты на столе. Карты оппонента остаются скрытыми. Это требует от ИИ способности рассуждать о скрытых состояниях – то есть, строить вероятностные модели о возможных картах оппонента, его стратегии и его «ментальной модели» о вашей руке. LLM, хоть и способны генерировать текст и отвечать на вопросы, испытывают трудности с построением и обновлением таких сложных вероятностных моделей в реальном времени, особенно когда эти модели должны учитывать психологические аспекты и возможный блеф.

2. Недостатки в представлении информации и планировании

Как LLM «видят» покерный стол? Для них это последовательность текстовых описаний или токенов. Перевести эту текстовую информацию в эффективное стратегическое планирование – непростая задача. Исследователи отмечают, что существуют явные возможности для улучшения репрезентации покерной ситуации для LLM. Если модель не может адекватно «представить» себе состояние игры, включая потенциальные руки оппонента и их последствия, она не сможет выработать оптимальную стратегию.

3. Отсутствие специализированного планирования и адаптации

LLM – это модели общего назначения. Они не создавались специально для игры в покер. Специализированные покерные ИИ, такие как GTO Wizard AI, используют сложные алгоритмы на основе теории игр, которые просчитывают оптимальные стратегии для миллионов сценариев. LLM же пытаются применить свои общие рассуждения к очень специфической и динамичной задаче. Им не хватает глубокого понимания вероятностей, комбинаторики и, что самое важное, способности к многошаговому стратегическому планированию, которое постоянно адаптируется к действиям оппонента и изменению информации.

4. Блеф и психология: Непостижимая территория

«Блеф – это не просто случайный акт обмана; это тщательно рассчитанный риск, основанный на анализе поведения оппонента, его вероятной руки и того, как он может воспринять вашу ставку. Это требует понимания психологии, которого пока нет у LLM».

Блеф – неотъемлемая часть покера. Он требует не только математического расчёта, но и умения «читать» оппонента, понимать его склонности и использовать их против него. LLM не обладают эмпатией или способностью к психологическому моделированию в человеческом смысле. Они не могут эффективно имитировать человеческое поведение в условиях стресса или неопределённости, что является критическим аспектом успешного блефа.

Практические выводы для развития ИИ: Уроки из покерного стола

Поражение LLM в покере – это не признак их слабости в целом, а скорее ценный урок для всего сообщества исследователей ИИ. Этот опыт указывает на несколько важных направлений для будущего развития:

1. Необходимость гибридных моделей

Универсальность LLM впечатляет, но для задач, требующих глубокой специализации, возможно, потребуется сочетание больших языковых моделей с другими архитектурами. Это могут быть гибридные модели, где LLM отвечают за высокоуровневое рассуждение и понимание контекста, а специализированные модули (например, на основе алгоритмов теории игр или обучения с подкреплением) занимаются точным расчётом вероятностей, стратегическим планированием и адаптацией в условиях неполной информации.

2. Важность бенчмарков с частичной наблюдаемостью

GTO Wizard Benchmark демонстрирует критическую потребность в новых, более сложных бенчмарках. Тестирование ИИ в средах с частичной наблюдаемостью, где информация неполна и динамична, является ключом к созданию по-настоящему интеллектуальных систем, способных работать в реальном мире. Такие бенчмарки стимулируют развитие ИИ, способного к эффективному планированию и рассуждению в условиях неопределённости, что актуально не только для игр, но и для таких областей, как финансы, переговоры, логистика и даже военные стратегии.

3. Развитие «ментальных моделей» и понимания неопределённости

Будущие исследования должны сосредоточиться на том, как ИИ может лучше строить и обновлять «ментальные модели» других агентов, а также как более эффективно рассуждать о вероятностях и неопределённости. Это включает в себя улучшение способности LLM к индуктивному и дедуктивному рассуждению в условиях неполных данных, а также к пониманию последствий своих действий в долгосрочной перспективе с учётом возможных ответных шагов оппонента.

4. Применение уроков за пределами игры

Проблемы, с которыми столкнулись LLM в покере, имеют прямые параллели с вызовами в реальном мире. Представьте себе ИИ, который ведёт переговоры, управляет инвестиционным портфелем или даже руководит автономными системами в сложной, непредсказуемой среде. Все эти задачи требуют умения работать с неполной информацией, предвидеть действия других агентов и принимать решения в условиях риска. Уроки, извлечённые из покерного стола, могут стать основой для создания более надёжного, адаптивного и интеллектуального ИИ для широкого спектра практических применений.

Заключение: Покер — не просто игра, а полигон для интеллекта

История с поражением GPT-5.4 и Claude.6 в покере – это не история провала, а история важного открытия. Она показывает, что, несмотря на впечатляющие достижения в области больших языковых моделей, существуют фундаментальные аспекты интеллекта, особенно связанные с рассуждением в условиях неполной информации и стратегическим взаимодействием, где ещё предстоит проделать огромную работу. GTO Wizard Benchmark предоставляет мощный инструмент для этой работы, предлагая точную и сложную среду для оценки. Это напоминание о том, что путь к созданию по-настоящему универсального и сильного искусственного интеллекта долог и тернист, но каждый такой «проигрыш» становится бесценным уроком, указывающим на новые горизонты для исследований и инноваций.

Покер, со всей его сложностью и неопределённостью, продолжает оставаться уникальным полигоном для тестирования пределов искусственного интеллекта. И пока LLM не научатся блефовать так же тонко, как человек, или просчитывать скрытые вероятности с точностью GTO Wizard AI, мы будем наблюдать за этим увлекательным соревнованием, которое, несомненно, приведёт к новым прорывам в понимании и создании интеллектуальных машин будущего.